随着 AI 能力增长,人类意图为何变得更重要

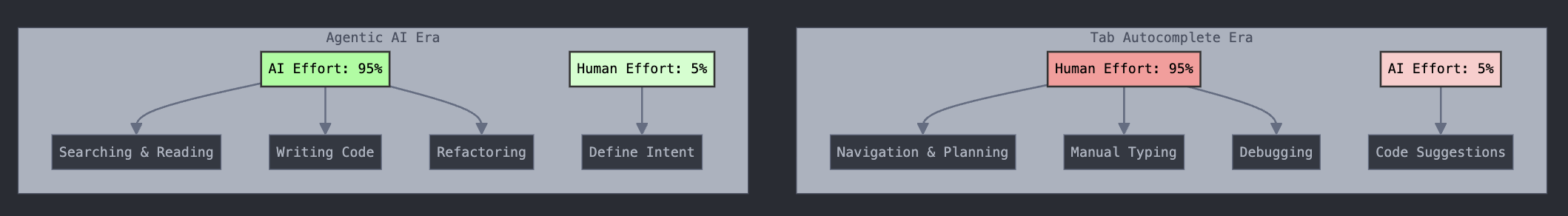

还记得人工智能编码仅仅意味着按 Tab 键自动补全的时代吗?那时人类完成了 95% 的工作:导航代码库、找到正确的文件、定位确切的编辑位置、开始输入,然后人工智能才能提供有用的建议。人类是司机,人工智能几乎只是乘客。

今天的代理式人工智能可以搜索代码库、阅读文件、编写整个模块、重构系统,并协调跨多个文件的复杂更改。有了像 Cline 这样的工具,人工智能几乎占据了整个编码工作的“馅饼”。这引出了一个引人深思的问题:如果人工智能几乎可以做所有事情,那人类还剩下什么?

答案出奇地简单: 意图。

最后一英里是最重要的一英里

随着人工智能能力的扩展,人类的作用并没有减弱;它正在转变。当人工智能可以处理编码的机制时,关键问题变成了: 我们在构建什么以及为什么?

把它想象成一个工作量的饼图。在 Tab 自动补全时代:

- 人类工作量:95%(导航、规划、输入、调试)

- 人工智能工作量:5%(建议)

在代理时代:

- 人工智能工作量:95%(搜索、阅读、编写、重构)

- 人类工作量:5%(意图)

但这 5% 是全部。这是完美地构建错误东西的人工智能与构建你真正需要的东西的人工智能之间的区别。

我们为什么要构建“计划-执行”范式

问题在于:人工智能是 急切的。给它读取和写入文件的工具,它就想立即开始编码。这就像有一个非常有才华的开发人员,在完全理解需求之前就开始构建。

这种急切不是一个缺陷;它是这些模型工作方式的一个特征。它们被设计为乐于助人、采取行动、解决问题。但如果没有清晰的意图,这种行动可能会被误导。

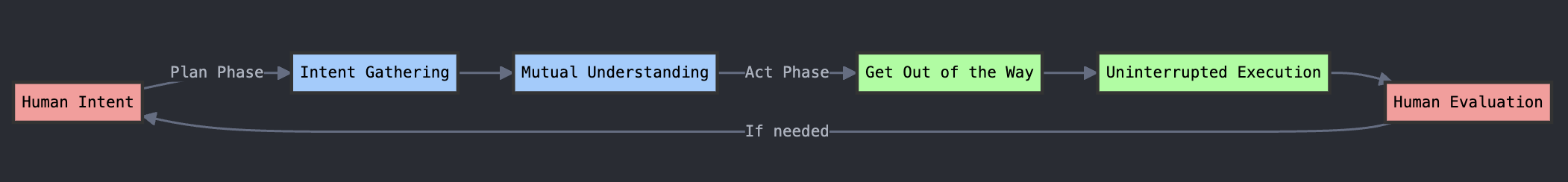

“计划-执行”范式不是为了给人工智能创建不同的“模式”;它是为了认识到有效的协作具有自然的阶段。在“计划”阶段,我们为相互理解创造了审慎的空间。我们设计了人工智能,使其尽可能地探究人类的意图。不是因为人工智能缺乏能力,而是因为意图是唯一不能被自动化的东西。

然后是“执行”,我们让开道路。同样的人工智能,同样的能力,但现在优化为不间断的执行。这是一种我们互动方式的范式转变,而不是一种个性切换。

反角色哲学(以及为什么“计划-执行”不是“模式”)

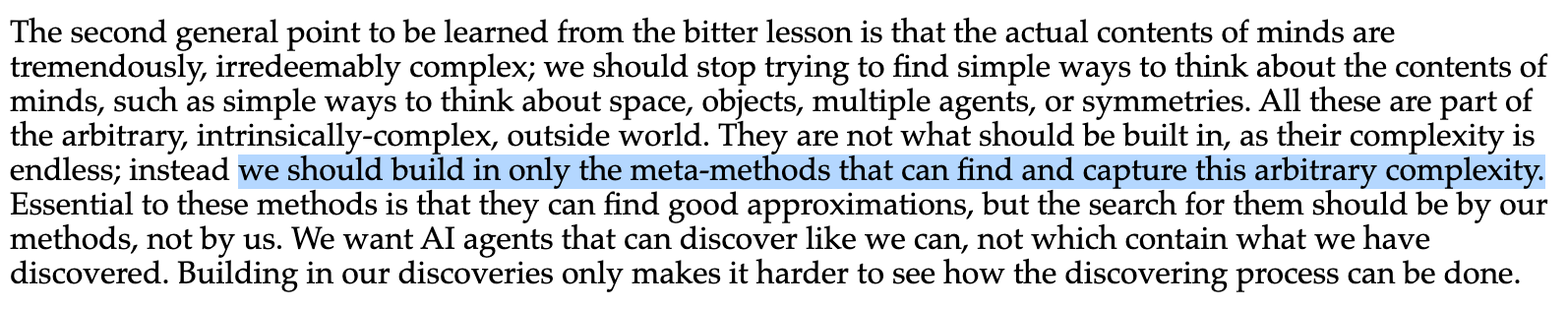

你可能见过带有专业“代理”的编码助手:一个调试器、一个架构师、一个代码审查员。我们刻意避免这种方法,原因如下。

理查德·萨顿(Richard Sutton)在人工智能研究中的 “苦涩教训” 表明,利用计算的通用方法始终优于专门的、由人类设计的解决方案。当深蓝击败卡斯帕罗夫时,它没有使用大师级策略;它使用的是蛮力搜索。当 AlphaGo 征服围棋时,它没有遵循古代智慧;它使用的是通用学习算法。

像 Claude Sonnet 4 和 Gemini 2.5 Pro 这样的现代语言模型经过了整个编码过程的训练。它们见过数百万个架构决策、调试会话和代码审查的例子。创建人为的角色会限制它们天生就知道该做什么。

这一点至关重要: “计划”和“执行”不是不同的人工智能个性或能力的“模式”。我们不是在“规划人工智能”和“编码人工智能”之间切换。它是贯穿始终的相同人工智能,具有相同的功能。

改变的是 互动范式。在“计划”中,我们优化意图收集;人工智能提出问题、探索上下文、确保理解。在“执行”中,我们优化执行;人工智能不受干扰地使用其全部能力。这是关于认识到人机协作的自然节奏,而不是将人工智能限制在不同的角色中。

把它想象成对话与专注工作之间的区别。你不会说一个开发人员在需求会议上和编码时有不同的“模式”。他们是同一个人,只是处于工作的不同阶段。

不要打断人工智能

我们观察到了一些非常深刻的现象:大型语言模型是出色的 讲故事者。它们是预测性文本引擎,旨在编织连贯的叙事:发生这个,然后发生那个,再发生这个。

当你中断人工智能以纠正方向时,你会打破这种叙事流。模型现在必须将其干预与其先前的轨迹协调起来,这通常会导致混乱或次优解决方案。

斯坦福大学的 “失落于中间” 研究(Liu 等人,2023)表明,在处理中断上下文时,大型语言模型的性能会显着下降。研究发现,当相关信息出现在长上下文的中间而不是开头时,模型的准确性会下降近 20%。重新开始,虽然看起来效率低下,但通常会产生更好的结果,因为模型可以从清晰的意图中构建一个干净的叙事,而无需在降级的中间上下文中导航。

这就是为什么从更清晰的指令重新开始通常优于试图纠正方向的原因。保存你的状态,让人工智能工作,然后要么接受结果,要么重新开始,而不是纠结于修正。

随着推理变得更便宜,我们甚至可以并行运行多次尝试并选择最佳结果,把它看作是一个老虎机,每一次新的拉动都有独立的成功概率。

让人工智能发挥

一旦你在“计划”阶段分享了你的意图,下一个原则同样重要:让开道路。

这直接与我们的反角色哲学相关联。正如我们不将人工智能限制在“调试器”或“架构师”等人工角色中一样,我们也不在执行期间限制它。“执行”阶段是关于让模型使用其所有能力:架构决策、调试、重构、优化,作为一个统一的智能。

我们观察到,最新的 Claude 4 模型在自动批准下运行时表现良好。每一次中断都会打破叙事流。最有效的会话是当人工智能可以不间断地编写时。

注意:模型最佳性能来自于让它们不间断地构建。但是,结果可能并不总是符合你的意图。因此,如果你正在进行复杂的工程工作,我们仍然建议你保持关注,更重要的是,详细定义你的计划。

这可能感觉违反直觉。我们不需要控制吗?监督吗?干预的能力吗?

是的,但不是在当下。这就是为什么我们构建了

- 检查点:可以返回保存状态

- 完全可见性:查看人工智能正在做的一切

- 撤销功能:还原任何更改

- 安全边界:定义人工智能可以和不能触及的范围

关键的洞察是时机。收集需求、分享意图、设置边界,然后让人工智能工作。在之后而不是之中进行审查和迭代。

编码的未来不是人类与人工智能竞争,也不是试图通过越来越狭窄的专业化来保持相关性。它是关于人类做只有人类才能做的事情:提供意图、意义和目的,而人工智能处理实现。

这并不是一个弱化的角色。这是最重要的角色。

-Nick